Retrieval-augmented generation (RAG): dalle risposte blu alle intelligenti

Dietro le risposte più intelligenti dei nuovi motori AI c’è la retrieval-augmented generation (rag), non la magia. Questa tecnica unisce modelli generativi e ricerca semantica per colmare il divario tra dati statici e domande reali.

Negli ultimi mesi abbiamo visto nascere prodotti come SearchGPT e ChatGPT Search, capaci di fornire risposte conversazionali aggiornate, con immagini e fonti. Allo stesso tempo Google sperimenta AI-first search con AI Overviews e SGE.

In questo scenario, il semplice testo ottimizzato SEO non basta più. Serve capire come funzionano i sistemi che recuperano e combinano conoscenza in tempo reale, a partire dai tuoi documenti.

Capire il RAG è cruciale per chi lavora con SEO, content, knowledge base aziendali o prodotti digitali. Da questa scelta dipendono affidabilità delle risposte, riduzione degli hallucination e reale utilizzo dei tuoi dati interni.

In questo articolo vedremo che cos’è – in pratica – la retrieval-augmented generation (rag), come funziona il suo flusso tecnico, perché è centrale per la nuova ricerca basata su Intelligenza Artificiale e come viene usata in progetti come SearchGPT.

Analizzeremo anche casi d’uso concreti, collegamenti con agenti AI e implicazioni per chi deve progettare contenuti e dati pronti per questa trasformazione.

Comprendere retrieval-augmented generation (RAG) e la sua unicità

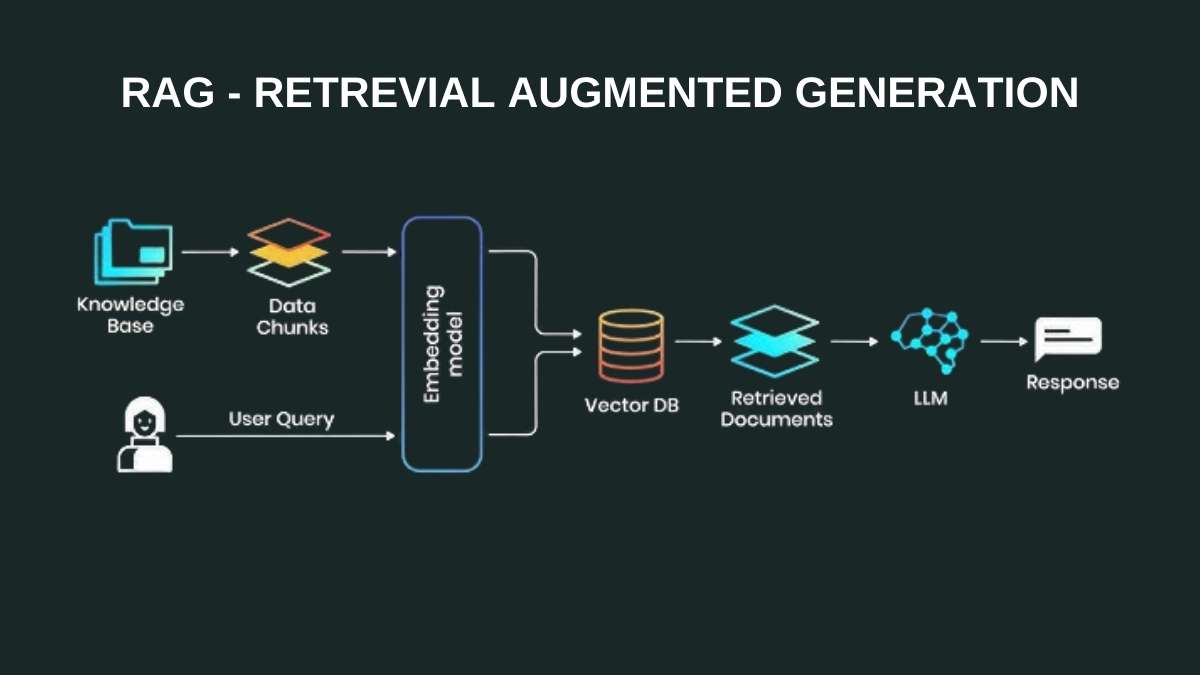

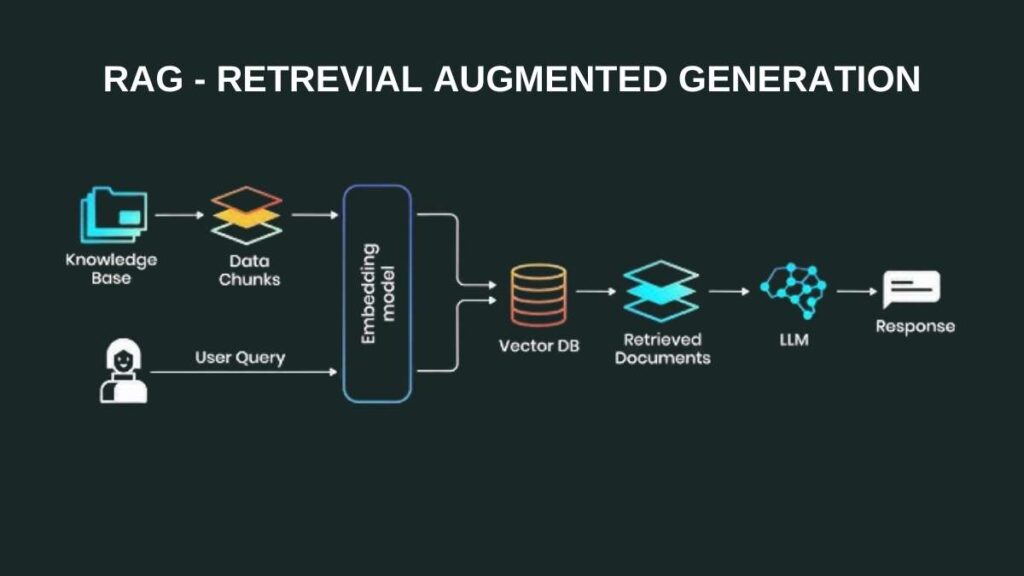

Quando parliamo di retrieval-augmented generation (rag) non stiamo descrivendo un nuovo modello, ma un’architettura. Il modello generativo rimane lo stesso; cambia il modo in cui riceve il contesto.

Nel RAG, i tuoi documenti vengono prima suddivisi in blocchi logici, come paragrafi o sezioni. Per ogni blocco si calcola un embedding, cioè una rappresentazione numerica del significato. Questi vettori vengono salvati in un vector store interno.

Quando l’utente fa una domanda, la query viene trasformata nello stesso spazio vettoriale e confrontata con i documenti indicizzati. I blocchi più pertinenti vengono recuperati e inseriti nel prompt del modello, che così risponde usando contenuti aggiornati e specifici.

Nei GPT personalizzati di OpenAI, questa pipeline di knowledge retrieval si attiva automaticamente quando carichi file e abiliti il recupero. Non stai più “insegnando” tutto al modello tramite fine-tuning, ma gli dai la capacità di consultare una base documentale esterna ogni volta che serve.

Il risultato è che il modello può rispondere su manuali aziendali, politiche interne o procedure aggiornate senza dover essere riaddestrato. In altre parole, la retrieval-augmented generation (rag) trasforma il modello da enciclopedia pre-addestrata a interfaccia intelligente verso la tua conoscenza.

Retrieval-augmented generation (RAG) e l’evoluzione della ricerca AI

La retrieval-augmented generation (rag) è il motore nascosto della nuova Intelligenza artificiale generativa applicata alla ricerca. Senza un recupero solido delle fonti, nessuna risposta può essere davvero affidabile.

Nel luglio 2024 OpenAI ha presentato il prototipo SearchGPT a circa 10.000 utenti negli Stati Uniti.

L’obiettivo: unire motore di ricerca e modello generativo, con risposte conversazionali, immagini e link diretti alle fonti. Da ottobre 2024 queste funzioni sono confluite in ChatGPT Search per gli abbonati Plus e Team, fino ad arrivare a dicembre 2024 a una versione gratuita per tutti gli account.

Oggi la stessa interfaccia ti restituisce notizie in tempo reale, dati sportivi, meteo o quotazioni, sempre accompagnati da fonti.

Google sta seguendo una direzione simile con AI Overviews e Google SGE, mentre strumenti come Perplexity AI mostrano già da tempo risposte sintetiche con citazioni puntuali. In tutti questi casi, il modello generativo lavora sopra uno strato di ricerca semantica e indicizzazione avanzata.

Per chi si occupa di SEO e contenuti, questo significa progettare pagine, dati strutturati e fonti in modo che siano facilmente “consumabili” da sistemi RAG.

Non si tratta più solo di scalare le SERP tradizionali, ma di diventare la base documentale privilegiata dei nuovi motori conversazionali.

Progettare un sistema aziendale con retrieval-augmented generation (RAG)

Portare la retrieval-augmented generation (rag) in azienda richiede molto più di un semplice connettore verso i file. Serve un’architettura chiara, pensata per reggere nel tempo.

Il flusso tipico parte dalla normalizzazione delle fonti: PDF, pagine web interne, tool di ticketing, CRM.

Poi entrano in gioco il document splitting e la creazione di index vettoriali, alimentati da modelli di embedding aggiornati.

A questo livello diventa decisiva una buona Vector Index Hygiene, cioè regole precise su deduplicazione, versione dei contenuti, cancellazione sicura e aggiornamenti incrementali.

Senza queste pratiche, il tuo vector store diventa rapidamente rumoroso e poco affidabile.

Hai, per esempio, una knowledge base con centinaia di articoli di supporto in tre lingue.

Un’azienda che struttura un RAG efficace definisce una chiara tassonomia, decide granularità dei blocchi, inserisce metadati per lingua, prodotto, area geografica e stabilisce una governance dei dati: chi può aggiornare cosa, con quali workflow di revisione.

Su questo strato si costruiscono poi le pipeline di query, i filtri per permessi, e gli eventuali strumenti di moderazione.

A quel punto il modello può generare risposte contestualizzate e sicure. Un sistema RAG ben progettato diventa quindi la spina dorsale informativa di chatbot interni, help center avanzati e strumenti decisionali su misura.

Casi d’uso concreti del RAG in marketing, prodotto e formazione

La retrieval-augmented generation (rag) mostra il suo valore quando tocca problemi reali: ridurre tempi di ricerca, uniformare risposte, accelerare decisioni. Non è un esercizio teorico.

Pensiamo a un team di prodotto che usa Google NotebookLM per organizzare documentazione tecnica e note di ricerca. Integrando gli stessi documenti in un sistema RAG, gli stessi contenuti diventano base per chatbot interni che rispondono su roadmap, bug critici o specifiche API.

Un team di marketing può usare il RAG per generare rapidamente schede prodotto coerenti con le ultime release, senza rischiare errori presenti in vecchi file. Nel customer care, un assistente basato su RAG riduce tempi medi di risposta perché arriva subito agli articoli più aggiornati.

Ecco i principali elementi che rendono questi use case realmente efficaci:

- Allineamento tra contenuti, metadati e casi d’uso concreti

- Processo di revisione che aggiorna spesso la base documentale

- Monitoraggio delle domande per scoprire gap di conoscenza

- Chiarezza su cosa può o non può fare l’assistente

In tutti questi scenari, la retrieval-augmented generation (rag) non sostituisce le persone ma amplifica la qualità di documentazione tecnica, formazione interna e customer support. Il vero salto avviene quando team diversi condividono la stessa base informativa, invece di lavorare su silos scollegati.

RAG, agenti AI e interfacce vocali: cosa sta arrivando

La retrieval-augmented generation (rag) non vive isolata: è il “motore di conoscenza” di molti Agenti AI e interfacce vocali emergenti. Sta cambiando anche il modo in cui parliamo con i sistemi.

Gli aggiornamenti di Google sulla ricerca vocale, come Speech-to-Retrieval, mostrano come la voce possa diventare il punto di ingresso naturale a grandi basi documentali.

In parallelo, agenti autonomi orchestrano più chiamate RAG per completare compiti complessi: analizzare contratti, confrontare offerte, sintetizzare report. Ogni agente diventa così un coordinatore che interroga, filtra, valuta fonti e solo alla fine chiede al modello generativo di produrre una risposta.

Immagina un agente che supporta il team legale: riceve una domanda in linguaggio naturale, converte la richiesta, interroga il sistema RAG interno, recupera clausole simili, evidenzia rischi e propone versioni alternative. In settori regolamentati, questa combinazione consente di restare aderenti alle policy mentre si guadagna velocità operativa.

Per i motori di ricerca di nuova generazione, la convergenza tra voce, agenti e RAG significa passare dal “trovare una pagina” al “delegare un compito”.

Chi progetta contenuti dovrà quindi pensare meno a singole query e più a flussi informativi che possano alimentare agenti, assistenti vocali e interfacce conversazionali sempre attive.

Perché il RAG diventa il nuovo strato fondamentale della ricerca

La retrieval-augmented generation (rag) rappresenta un cambio di paradigma silenzioso ma profondo. Non è solo una tecnica di retrieval, ma un nuovo livello infrastrutturale tra dati e modelli generativi.

Mentre strumenti come SearchGPT, ChatGPT Search, AI Overviews o Perplexity AI ridisegnano i risultati di ricerca, molti continuano a ragionare solo in termini di ranking e keyword.

Il punto, invece, è chiedersi se i propri contenuti sono strutturati per alimentare sistemi RAG: ben segmentati, arricchiti da metadati, facilmente indicizzabili nei vector store.

Chi inizia ora a progettare ecosistemi RAG robusti costruisce un vantaggio competitivo destinato a durare.

Perché i modelli cambieranno, ma la capacità di esporre conoscenza in modo interrogabile resterà il vero asset. La prossima fase non sarà dominata da trucchi SEO, ma da contenuti e dati pronti per la ricerca conversazionale.

La domanda diventa quindi meno “come posizionarsi” e più “come farsi comprendere” da sistemi sempre più intelligenti. È in questa capacità di dialogare con le macchine che si giocherà il futuro delle strategie digitali.